الذكاء الاصطناعي يغزو التعليم العالي

سارة هادلستون،

كل مقال أو دراسة جديدة تقريبًا يحمل التحذير نفسه للتعليم العالي: الذكاء الاصطناعي موجود في كل مكان. فهو حاضر في مشاركات النقاش التي يسلّمها الطلاب قبل دقائق من الموعد النهائي، وفي الواجبات الأسبوعية، وفي الامتحانات المنزلية. بل إنه موجود حتى في نظام إدارة التعلّم. ونتيجة لذلك، أصبح الذكاء الاصطناعي حاضرًا أيضًا في الخطط الدراسية للعديد من المقررات.

سياسات الأساتذة

طلبت ذا كرونيكل من عدد من المدرسين والخبراء (نحو 12 شخصًا) أن يصفوا سياساتهم المتعلقة باستخدام الذكاء الاصطناعي هذا الخريف، وكيف تظهر هذه الإرشادات في الخطط الدراسية — وهي فرصة أساسية لتحديد نبرة الفصل الدراسي. تراوحت أساليبهم بين تعليمات مقتضبة تقتصر على التشديد على إنتاج أعمال أصلية، وجداول تفصيلية تتضمن سيناريوهات افتراضية توضّح متى يكون استخدام الذكاء الاصطناعي مقبولًا ومتى لا يكون كذلك.

ومعظم الكليات لا تملك سياسات موحّدة على مستوى الجامعة تتعلق بالذكاء الاصطناعي داخل الصفوف. ففي حين أن بعض المؤسسات تحتضن التقنية انطلاقًا من أن خريجي الجامعات يدخلون سوق عمل يتطلب كفاءات متزايدة في هذا المجال، لا تزال مؤسسات أخرى تحاول تحديد الكيفية التي يمكن — أو ينبغي — استخدام التقنية بها.

وغالبًا ما يُترك القرار للأستاذ نفسه ليحدد ما يجب فعله بشأن الذكاء الاصطناعي. ويقول أعضاء هيئة التدريس إن هذه المهمة قد تبدو مرهقة.

قال بيتر شيا، العميد المساعد للابتكار الرقمي ودمج الذكاء الاصطناعي في كلية ميدلسكس بولاية ماساتشوستس:

“أعتقد أننا نعيش تحولًا شبيهًا بما حدث عندما انتقل اقتصاد البلاد من النموذج الزراعي إلى النموذج الصناعي. كيف يمكن تنظيم ما يبدو غير قابل للتنظيم؟“

مواقف متباينة

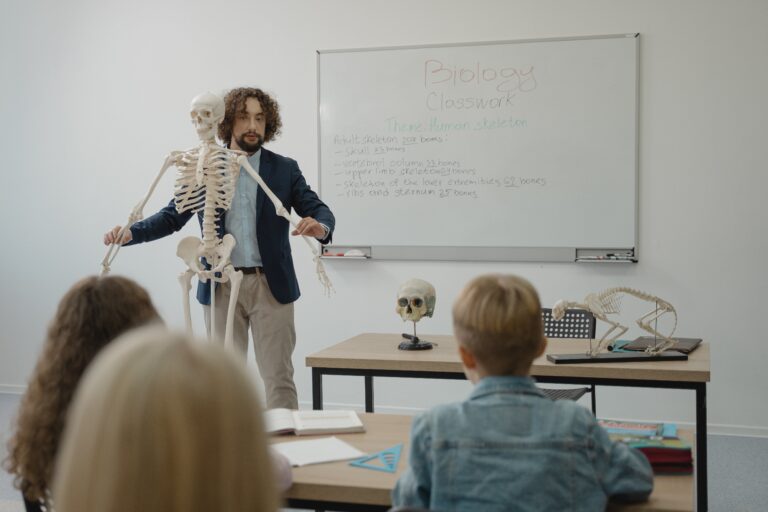

اختار بعض أعضاء هيئة التدريس فرض قيود صارمة على استخدام الذكاء الاصطناعي وأوضحوا ذلك صراحة في خططهم الدراسية. فيما أضاف آخرون مكوّنات خاصة بالتقنية إلى واجباتهم. أما الغالبية، فاتخذوا موقفًا وسطيًا بين الطرفين.

وبغض النظر عن الموقف، يؤكد خبراء التدريس أن وجود سياسة واضحة تحدد ما هو مسموح وما هو محظور — وكيف سيتم تطبيقها — أمر أساسي.

صياغة السياسات

بدأت جامعة ولاية جورجيا مؤخرًا بتزويد الأساتذة ببيانات نموذجية يمكن إدراجها في الخطط الدراسية حول الذكاء الاصطناعي، بما يتماشى مع سياسات النزاهة الأكاديمية بالجامعة. وتنقسم اللغة النموذجية إلى ثلاث فئات:

-

مسموح بالذكاء الاصطناعي ما لم يُذكر خلاف ذلك.

-

مسموح فقط في حالات معينة.

-

محظور تمامًا.

كما أعدّت جامعة ولاية أوهايو وجامعة واشنطن في سانت لويس موارد مشابهة.

لكن جينيفر دنكان، أستاذة اللغة الإنجليزية المساعدة في جامعة ولاية جورجيا، رأت أن طلابها بحاجة إلى توجيه أكثر تخصيصًا. بالنسبة إليها، كان إعداد سياسة أمرًا عاجلًا، خصوصًا أنها تدرّس عبر الإنترنت بالكامل وتدرك أن طلابها سيستخدمون الذكاء الاصطناعي بطريقة ما.

لذلك لجأت إلى الذكاء الاصطناعي التوليدي نفسه، فأدخلت معاييرها الشخصية وسياسة نزاهة أكاديمية سابقة، ثم عدّلت ما حصلت عليه.

تطلب دنكان من طلابها توثيق استخدامهم للذكاء الاصطناعي كما يفعلون مع أي مصدر آخر، وأن يتضمن كل واجب بيانًا بالإفصاح عن ذلك. بعض واجباتها تدمج التقنية مباشرة: فقد يستخدم الطلاب الذكاء الاصطناعي لإنشاء صور أو كشريك في مقابلة، بحيث يتظاهر الطالب أن برنامج المحادثة هو مقدم برامج حوارية أو شخصية الدكتور فرانكشتاين.

ودنكان ليست وحدها؛ فقد استعان أساتذة آخرون بالذكاء الاصطناعي التوليدي لصياغة سياسات تتعلق باستخدامه.

براين لي، أستاذ مشارك في قسم نظم المعلومات الحاسوبية بكلية بيرس وفي كلية الأعمال بجامعة واشنطن في تاكوما، قال إنه أدرك الحاجة إلى سياسة مساق حول الذكاء الاصطناعي في أوائل 2023، عندما “أصبح لدى الجميع فجأة نحو لغوي مثالي في مشاركات النقاش.”

أخذ لي عدة سياسات منشورة على الإنترنت، وطلب من ChatGPT دمجها، ثم حرر النتيجة بما يناسبه. وهو يحدّث السياسة كل صيف لتواكب التطورات التقنية، وقد وصل الآن إلى الإصدار الثالث. على سبيل المثال، يطلب من الطلاب الذين يستخدمون الذكاء الاصطناعي في واجباتهم أن يرفقوا رابطًا لسجل محادثاتهم مع ChatGPT، حتى يتمكن من مراجعة التعليمات التي أوصلتهم إلى إجاباتهم.

نظام الضوء الأحمر والأخضر

اعتمدت أبريل رايت، طالبة دكتوراه في دراسات الاتصال بجامعة وست فرجينيا، نظام إشارة المرور لمساقها في التواصل التجاري:

-

الضوء الأخضر: استخدام الذكاء الاصطناعي للعصف الذهني أو تحرير عمل أصلي.

-

الضوء الأصفر: استخدام الذكاء الاصطناعي لتوليد أفكار للسيرة الذاتية أو خطابات التغطية أو تحسين العرض الشخصي أو التدريب على مقابلة أو صياغة ملخصات وظيفية على لينكدإن، بشرط إعادة صياغة المحتوى بكلمات الطالب نفسه.

-

الضوء الأحمر: النسخ واللصق المباشر لمحتوى مولّد دون مراجعة أو تعديل.